柳田邦男×酒井邦嘉、生成AI特別対談・完全版...教育での活用は「リスク高い」

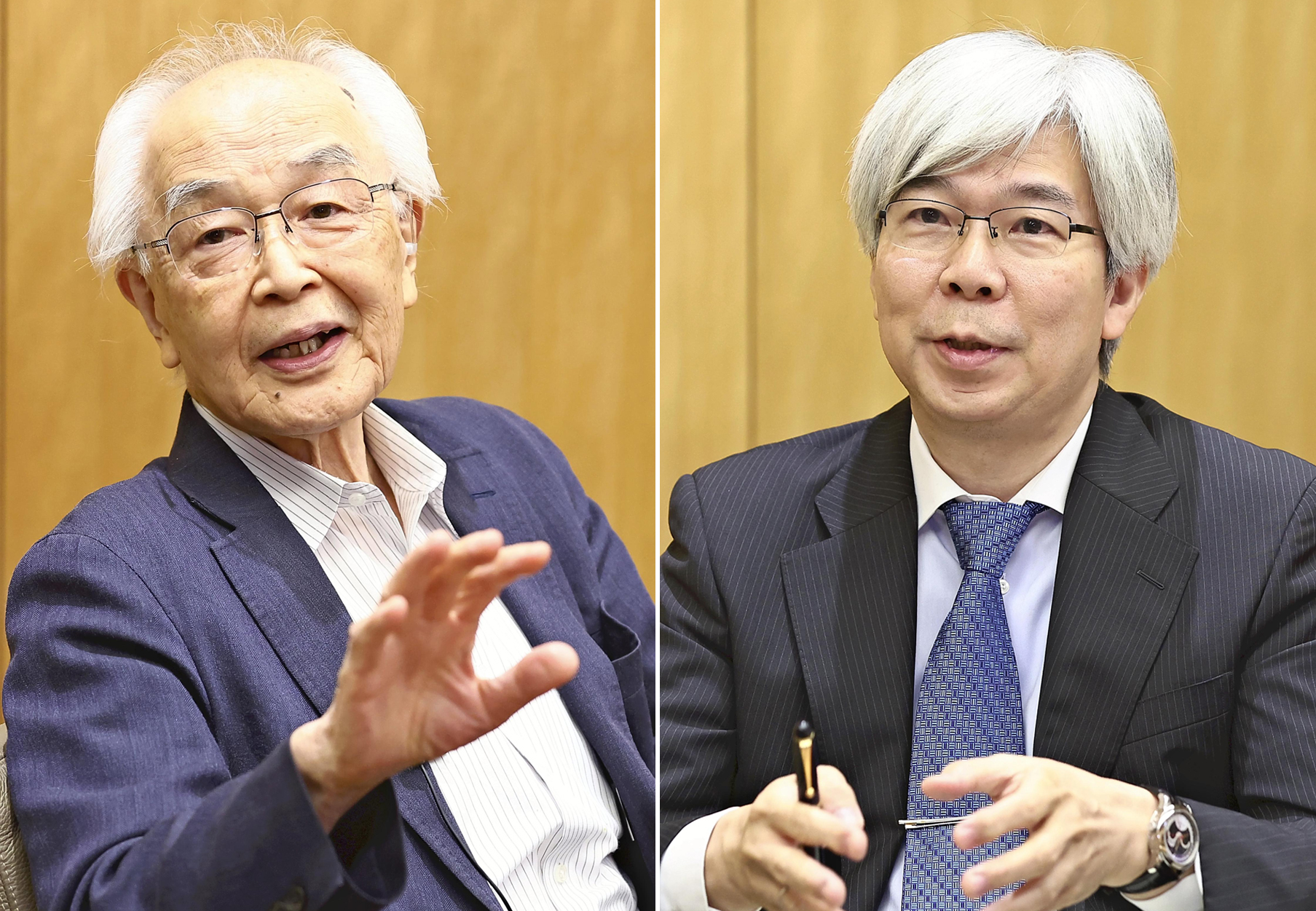

チャットGPTなどの生成AI(人工知能)への懸念が広がっている。文章や画像を手軽に作り出せる一方、安易な利用は人間の持つ創造力を低下させかねない。特に発達段階にある子どもたちと向き合う学校はどう対応すべきなのか。ノンフィクション作家の柳田邦男さん(87)と東京大教授の酒井邦嘉さん(58)が7月13日、読売新聞東京本社で、「生成AIに対する『危機管理』とは―教育現場での活用の是非―」をテーマに語り合った。

「賢く活用」は可能なのか

酒井 生成AIの安易な活用について、非常に強い危機感を持っています。科学的な研究の延長線上にこの技術があることは理解できますが、技術自体が独り歩きし、人間が本来持つ創造力や心のあり方に悪影響を及ぼす可能性があります。 柳田 生成AIという新しい技術は、人間の知性・感性の根幹に触れる問題をはらんでいます。人間の知的活動の中で一番大事な言語機能、あるいは思考力に関わる。導入が一体どんな意味を持つのか哲学的に捉えないといけない。専門家の議論だけでなく、教育に関わる一人ひとりが深い造詣を身につけ、是非を考えるべきです。

柳田 生成AIという新しい技術は、人間の知性・感性の根幹に触れる問題をはらんでいます。人間の知的活動の中で一番大事な言語機能、あるいは思考力に関わる。導入が一体どんな意味を持つのか哲学的に捉えないといけない。専門家の議論だけでなく、教育に関わる一人ひとりが深い造詣を身につけ、是非を考えるべきです。

酒井 生成AIを「賢く活用しよう」という議論がありますが、生成AIにできるのは言葉を並べて文章を作ったり、疑似的な対話をしたりすることだけです。相手の気持ちや言葉の周りにある背景を解析することはできません。それなのに、作られた文章や対話を自分で勝手に解釈して、理解したような感覚に陥る。考えたり、想像したりする力がどんどん衰えるのではないかと危惧しています。

想像的な思考、失う恐れ...柳田

柳田 スマートフォンと同じように生成AIへの依存も問題です。テレビで見たのですが、ある学校では生徒たちが課題について議論して答えを出した後、それをAIで確認していた。合っていると全員がほっとした表情になった。AIが「神の声」のように絶対的に正しい答えを出してくれると思っているようでした。

人間は依存に陥る危険性を持っています。麻薬やアルコールだけでなく、便利なもの、ちょっと面白いものに傾斜していく。AIに依存することで人間の主体性や創造的な考え方、自分が感じたことを言語化するという脳の働きが壊れていくのではないでしょうか。

酒井 特に対話型AIへの依存は危険です。自分の意見や考えに同意してくれたり、肯定してくれたりすると、「自分の考えは正しい」「社会を変えられる」などと危険な思い込みに陥る可能性がある。自分の良いように対話が引き出されるという生成AIが持つ「自己欺瞞」性にこそ、恐ろしさがあると思います。

人と議論するよりAIに依存する方が居心地がよくて、四六時中、手放せなくなる。もし小学校の頃からAIに慣れてしまえば、「もう友達も親もいらない」となりはしないでしょうか。ペットのようにかわいいAIだけあればいい。誰もその考えに修正を加えられず、ベルギーではAIと対話しているうちに自殺に至った例が報告されています。

柳田 スマホでもAIでも、コミュニケーションに用いられるのは、ほぼ文字だけ。せいぜい涙マークや笑顔マークといった記号が付くぐらいです。それでは本当の気持ちや感情は伝わらない。大事なのは、むしろ「ノンバーバル(非言語)コミュニケーション」です。

例えば終末期医療の現場。患者が最期の時を迎え、だんだん意識が薄れていく中では、言葉をかけることはもちろん、手を握ったり、頬をなでたり、そばに寄り添っていることの空気感が安心感を与える。AIの世界では、そうしたことがそぎ落とされ、人間の内面的な心の営みが壊れていくのではないでしょうか。

「対人間」こそ人を育てる...酒井

酒井 生成AIが教育現場に持ち込まれれば、大きな混乱を招きかねません。生徒が文章を書いても、本当に自分で書いたのか、少しAIを使ったのか、あるいは全部AIが書いたのか不明です。先生も「どうせAIを使ったんだろう」という目で見てしまえば、生徒の本当の実力がわからないし、評価もできない。生徒も、興味や関心があるものは自分でやるけれども、それ以外の宿題はAIに任せる。そういうことが現実に起きうるのです。

柳田 教育現場では、教科書の内容を学ぶ以上に、先生からの人間的な影響や、人と人との触れ合いがとても大事だと思います。僕の小中学校時代を思い出すと、「あの先生はこう言ってくれた」「あの時にこう声をかけられ、支えてくれた」といった記憶ばかり。AIを使って答えを導き、それが正解だという世界が支配的になってしまうと、先生という個性ある人間の存在が希薄になってしまう。

酒井 私は「教育は効率ではない」と言い続けています。効率だけを求めるのなら、生成AIを活用すればいい。教育現場で譲れないのは、やはり「対人間」であるべきだということ。同じ言葉でも、肉声で伝えることで言葉以上の情報が伝わる。そういうコミュニケーションができるのは人間だけなのです。

「危機管理」の観点

柳田 「危機管理」という観点からも、生成AIを教育に持ち込むのは、リスク要因が多い。

危機管理の取り組みには原則があります。まず起こり得る最悪の事態を想定し、そうなる様々なリスク要因に、万全の対策を立てる。その後に発生した事態に対しては、検証チームを設けて問題点を洗い出し、改善策を打ち出す。

危機管理の体制なしで導入したら大変なことになる。現時点でAIにはどんなリスクが潜んでいるのか、専門家による検証会議を開き、リスクの想定マップを作る必要がある。対談の中でも、いくつものリスクが示された。教育関係者をはじめ広い範囲の専門家が集まり、リスクに対応できるのか、それが難しいなら導入をやめるべきなのか、様々な議論がなされるべきです。

酒井 教育現場における生成AIの活用は非常にリスクが高い。例えば、学業や青春の悩みをたくさん抱えている孤独な学生が、生成AIに没入してしまう。その時にAIから得られた結論がもし自死だとしたら、誰が責任を取るのでしょう。

柳田 AIに対しては、それに負けないだけの感性や考える力、創造力を育てる取り組みが、今まで以上に重要になってくる。

酒井 子どもたちの印象に残るのは、先生が本当に楽しそうに勉強もそれ以外のことも伝えてくれる授業。人を教える、育てることができるのは人だけで、そのことを見失ったら教育ではなくなる。教育にAIが入り込む余地はないのです。

ノンフィクション作家

柳田邦男(やなぎだ・くにお)1936年、栃木県生まれ。東大卒業後、NHK記者を経て執筆活動に入り、災害や事故、医療問題などを取材。航空事故を題材にした「マッハの恐怖」や「犠牲(サクリファイス)わが息子・脳死の11日」など著書多数。

東京大学教授

酒井邦嘉(さかい・くによし)1964年、東京都生まれ。92年東大院理学系研究科博士課程修了。米ハーバード大リサーチフェローなどを経て現職。専門は言語脳科学。編著に「脳とAI―言語と思考へのアプローチ」(中央公論新社)など。

真偽の確認、より大切に

生成AIのリスクは、教育現場以外にも潜んでいる。対談後、柳田さんと酒井さんは記者の質問にも答えた。

――生成AIの台頭でフェイクニュースが拡散しないだろうか。生成AIが、民主主義や自由な言論空間に影響を及ぼす恐れはないか。

酒井「今までもフェイクニュースはありました。だから、生成AIを使っていいというのは非常に危険なロジックです。これまでもあってはならないことだったのですから。

むしろ、生成AIが作った映像や画像、音声がますます精緻なものとなり、リアリティーを持つようになると増幅しやすく、これまで以上に連鎖反応を生むようになる。市民は何が真実で、何が真実ではないのか、全く分からないまま踊らされてしまう。何をもって情報の真偽を確認し、どのような基準で発信したのかを今よりも示す必要が出てきます」

――研究者の間で生成AIに論文を書かせたり、仮説を立てさせたりしている例が見られる。人間の「知の営み」である研究の場などでの生成AI利用をどう考えるか。

柳田「科学に限らず、思想や哲学の分野でも、生成AIが今後使われる可能性はあると思います。そうなると、ただコンピューターの中で遊んでいるだけの世界になる。生身の人間がどんな暮らしをして、どんな人生を送っているかを現場感覚で見て、考えて、議論するという原点に立ち返ることを忘れてはいけない。

新聞を例に取ると、社会面は固有名詞を持った人間の物語がドラマチックに描かれているから心を動かされる。平均値で、誰にでも共通する話としてAIが教えてくれるような記事になってしまったら、社会面は存在しなくなるでしょう」

【主催】活字の学びを考える懇談会

【共催】文字・活字文化推進機構、読売新聞東京本社